草根影响力新视野 乔依丝编译

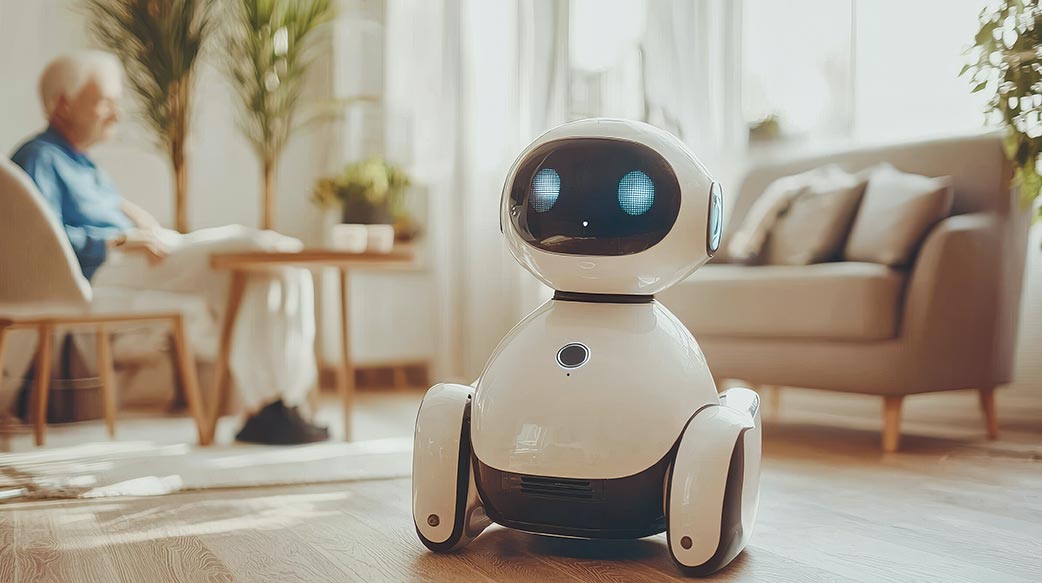

越来越多现代人因著感到孤独与无助而转向与AI聊天,并且渴望获得AI在情感上的支持,而这些行为让一些心理健康专家感到担忧。

美国心理学会临床心理师莉安娜·福图纳托 (Leanna Fortunato) 表示:“将 AI 用于治疗和情感陪伴的情况频繁出现。”人们向 AI 寻求心理支持的两种动机包括单纯想找个“绝对会倾听”的数码对象来发泄日常压力,以及看中 AI 的成本远低于真人心理治疗师,因此刻意将它当作便宜的替代方案来寻求建议。

在一项针对超过 2 万名美国成年人进行的健康研究调查中,10.3% 的参与者表示他们每天都会使用生成式 AI。在该群体中,有 87.1% 的人表示使用这项科技是出于个人原因,包含寻求建议和情感支持。这项研究于 1 月 21 日发表,由麻省总医院、威尔康乃尔医学院和东北大学等机构的研究人员共同进行。

在 TikTok 上,搜寻词“AI 治疗机器人”至少有 1150 万篇贴文,内容包罗万象,从使用者分享将聊天机器人变成心理治疗师的“最佳提示词”,到健康专家警告其中潜在危险的影片皆有。

图片取自:(示意图123rf)

科技巨头虽斥资将 AI 融入生活,但 AI 仍无法妥善应对严重的心理健康危机。据报导,曾有近 50 起美国民众在与 ChatGPT 对话时遭遇心理危机的案例,甚至包含 3 起死亡悲剧。尽管 OpenAI 等公司正与专家合作改善系统的敏感度,但研究指出,频繁依赖 AI 伴侣不仅可能削弱现实生活中的社交技能,还会增加孤独感。因此,美国心理学会强烈建议不应将 AI 视为心理治疗的替代品。

有些专家则是认为若能正确设定界线,AI 仍是一项有帮助的“辅助工具”。例如,AI 适合用来寻找心理健康卫教信息、生成写日记的反思提示,或提供相关研究文献; 将AI当作信息搜集工具,并将结果拿去与真实的治疗师讨论。

然而,AI 缺乏情感挑战能力,有时会一昧地顺从使用者的立场,这可能反而会助长使用者不健康的行为或思考模式。此外,透过AI获取健康信息后,请务必向专业医疗人员查证,或透过具公信力的医疗机构资源进行核实。

专家建议在使用AI时,绝对要避开这“三大红线”:

1.禁止用于危机求助与诊断,请务必直接拨打专业求助热线

2.绝对不要透露真实身分或医疗纪录,因为这些对话不受法律保密保护

3.AI无法解读语气与肢体语言,不应过度依赖它来解决现实中的人际关系问题

Reference:

When to talk to AI chatbots about mental health—and when to stay far away, professionals say