草根影响力新视野 法蓝瓷编译

网络上存在一些人们正在进行许多事的影片, 而事实上这些都不是当事者做的。我们可以看到影片是真人, 有著像照片一般栩栩如生的脸孔、画面, 但却全都是假的。

这样的影片有一个专有名词叫做‘深度伪造影片’(deepfakes), 是透过 AI 人工智能来修改的高端伪造技术。这样的技术一开始出现, 无可避免的是被运用在色情影片, 也就是将明星脸孔秀到女主角上, 真实度几可乱真, 不明究理的人会以为这是某个明星被狗仔偷拍外流的画面。而现在这样的技术也侵犯到政治领域, 带来的冲击不容小觑, 甚至让人们开始担心并开始建议英国政府、美国国会是否要开始立法规范一下。

这样的影片之所以开始被引起注意, 起因于今年五月份, 一位美国众议院议员Nancy Pelosi的媒体专访被人蓄意修改正常速度, 也就是将原本其正常速度降速75%, 降速过后的Nancy Pelosi在影片中就好像微醺及意识不清一般的陈述其言论 (链接)。这部被修改过后的影片在各平台上被疯传百万次以上, 分享者包含前美国纽约市市长及现任川普律师 Rudi Giuliani。讽刺的是, 这部影片甚至还没用到任何高端AI技术来制作。

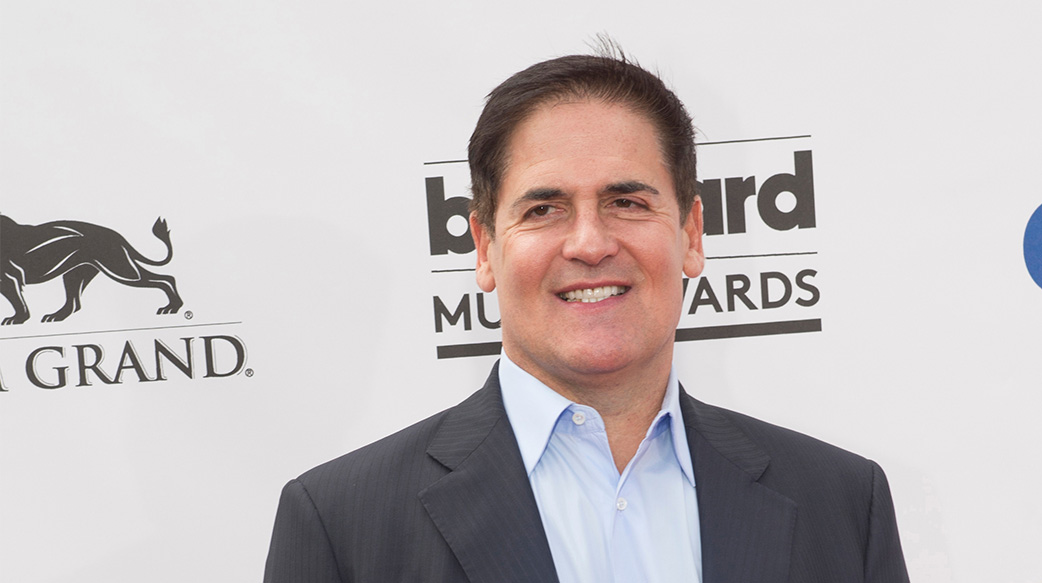

当Pelosi的影片传出后, ‘深度伪造’更将触角伸向许多的名人, 例如, 脸书执行长马克.祖克伯(Mark Zuckerberg)也在一段被恶搞的视频中阐述自己手上握有十几亿人个资, 并感谢神秘的Spectre 漏洞技术, 谁握有技术谁就掌握控制大权(链接)。我们可以在这边数算曾被恶搞的名人, 从娱乐界、科技业、到政经界都有, 只要有心人拿到录好的影像, 就可透过影像重新编排嘴型、陈述的内容, 最终让人被误导。

事实上, Spectre是利用OS操作系统在存取数码文件时所产生的漏洞来修改; Spectre使用的并非文件中单一漏洞, 而是一群漏洞, 而操作系统针对这样的漏洞是不容易修复的, 这让有心人可透过漏洞所提供的地利之便随时更改文件, 更改则透过开发的AI图像技术生成新图像。透过如此的图像生成技术, 不须用到真人也可让一般人误以为此人真的存在, 点选链接 (this person does not exit), 每刷新一次就会出现如真人般的照片。

‘在现今信息科技发达的现代, 许多人或许对资安的顾虑存在过多的恐惧, 但这一次不同。’英国牛津大学的牛津因特网协会 (Oxford Internet Institute)的AI人工智能法教授Sandra Wachter说道。‘任何发展过快或随意滥用的技术都有可能导致意料之外或不可控制的结果, 我们能够在这个事件中看到假消息是如何以最短的时间内被精良的制作出来, 进一步被如病毒般快速散播, 完全没经过查证就被疯传, 这是很可怕的。’

有鉴于此, 英国开始积极规划相关法令准备打假, 准备成为全球第一个针对假AI做出的消息有所规范的国家。虽然目前要搜集的资料繁多, 不过却是很重要的一步, 因为科技在往前走, 法令要追得上, 不能有灰色模煳地带。根据一份针对信息素养研究显示, 芬兰儿童对假消息真伪的辨别能力最高。因此在未来, 民众也需要提升信息素养来分辨消息的真假, 防止一错(原本就是假的)再错(还传出去)的窘况。

Reference : What do we do about deepfake video?